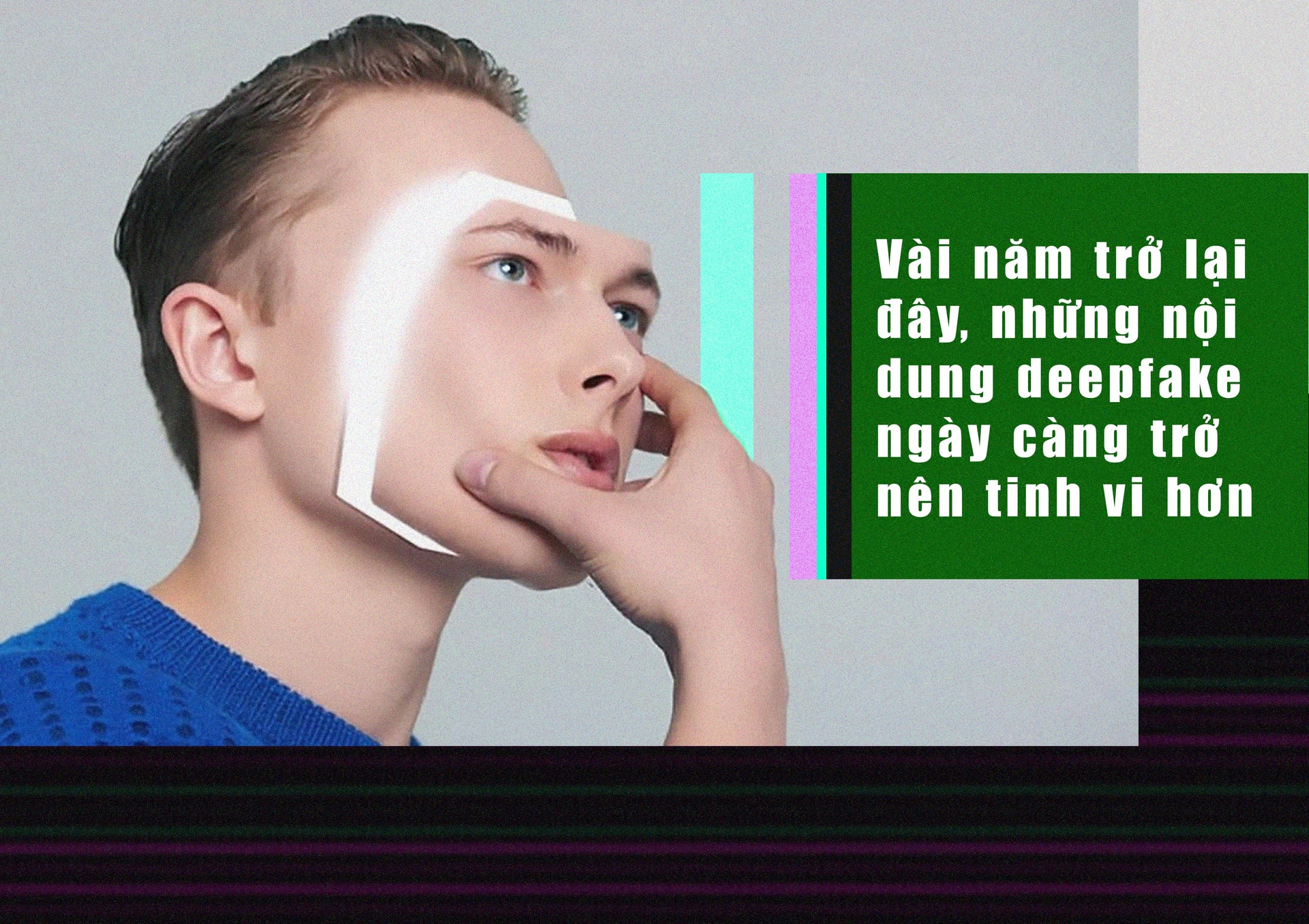

Nội dung deepfake đang ngày càng tinh vi và phổ biến hơn trên Internet. Điều này đặc biệt nguy hiểm khi nó có thể bị lạm dụng để thao túng, phát tán thông tin giả mạo.

Các ứng dụng máy ảnh ngày càng trở nên tinh vi. Người dùng có thể kéo dài chân, loại bỏ mụn, thêm tai động vật và bây giờ một số thậm chí có thể tạo ra các video giả trông rất thật. Công nghệ được sử dụng để tạo ra những nội dung kỹ thuật số như vậy được gọi là deepfake.

"Những video như vậy đang ngày càng trở nên tinh vi và dễ tiếp cận. Bất cứ ai sở hữu máy tính và có truy cập Internet đều có thể tạo ra nội dung deepfake. Công nghệ này đang làm dấy lên hàng loạt vấn đề liên quan đến chính sách, công nghệ và pháp lý" John Villasenor, chuyên viên cấp cao tại Trung tâm Đổi mới Công nghệ thuộc Viện Brookings ở Washington, cho biết.

Deepfake là một từ ghép, được tạo ra bằng cách kết hợp hai thuật ngữ gồm "deep learning" (học sâu) và "fake" (giả mạo), và là một dạng trí tuệ nhân tạo.

"Nói một cách đơn giản và dễ hiểu, deepfake là những video giả mạo được tạo ra bằng phương pháp học sâu", Paul Barrett, một giảng viên tại Đại học New York cho biết.

Học sâu là "một tập hợp con của AI", đề cập đến việc sắp xếp các thuật toán có thể tự học và đưa ra quyết định thông minh.

"Mối nguy hiểm của công nghệ này là nó có thể được sử dụng để khiến mọi người tin rằng điều gì đó có thật, trong khi sự thật không phải vậy", Peter Singer, chiến lược gia chuyên về an ninh mạng và quốc phòng tại New America, nhận định.

Một hệ thống học sâu có thể tạo ra sự giả mạo thuyết phục bằng cách nghiên cứu các bức ảnh và video của đối tượng mục tiêu từ nhiều góc độ, sau đó bắt chước hành vi và cách nói chuyện của người đó.

"Khi giả mạo sơ bộ được tạo ra, một phương pháp được gọi là GAN, hay các mạng đối nghịch chung, sẽ làm cho nó trở nên đáng tin hơn. Quy trình GAN tìm cách phát hiện các lỗ hổng trong việc giả mạo, dẫn đến các cải tiến để giải quyết những lỗ hổng đó. Sau nhiều vòng phát hiện lỗ hổng và cải tiến, video deepfake sẽ được hoàn thành", Barrett cho biết.

Theo nhận định từ MIT, một thiết bị hỗ trợ deepfake có thể trở thành một vũ khí nguy hiểm của những kẻ tung tin giả, những người muốn ảnh hưởng đến mọi thứ, như giá cổ phiếu hay các cuộc bầu cử.

"Trên thực tế, các công cụ AI đã được sử dụng để đưa hình ảnh khuôn mặt của những người khác vào cơ thể của các ngôi sao khiêu dâm và đưa lời nói vào miệng các chính trị gia", Martin Giles, trưởng văn phòng MIT Technology Review tại San Francisco, viết trong một báo cáo.

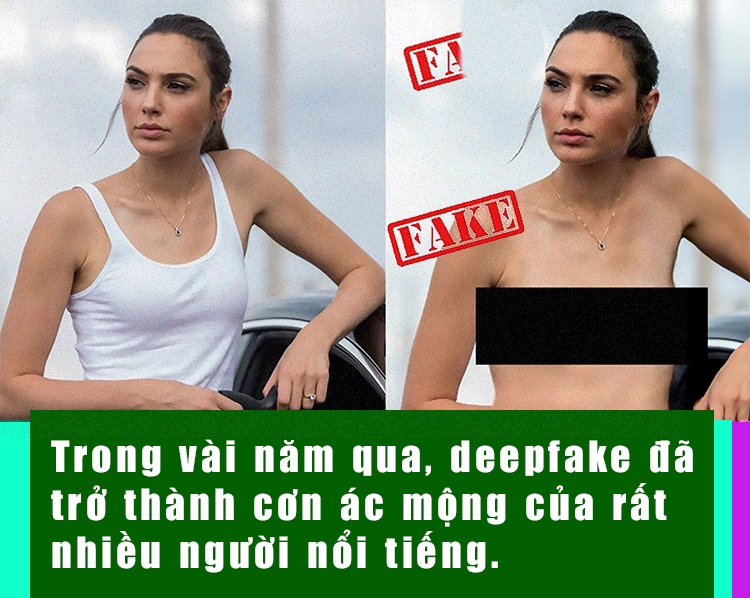

Ban đầu, những video deepfake chỉ được tạo ra với mục đích giải trí đơn thuần như biến diễn viên Tom Cruise trở thành nhân vật trong phim Iron Man. Tuy nhiên, công nghệ này càng lúc càng bị lạm dụng và trở thành "cơn ác mộng" đối với nhiều người, đặc biệt là những người nổi tiếng.

Theo đó, kẻ xấu đã sử dụng công nghệ này để tạo ra những sản phẩm phim khiêu dâm bằng cách ghép mặt của người nổi tiếng vào thân hình của các diễn viên trong phim người lớn. Hàng loạt diễn viên như Emma Watson, Gal Gadot, Scarlett Johansson,… đều đã trở thành nạn nhân của deepfake.

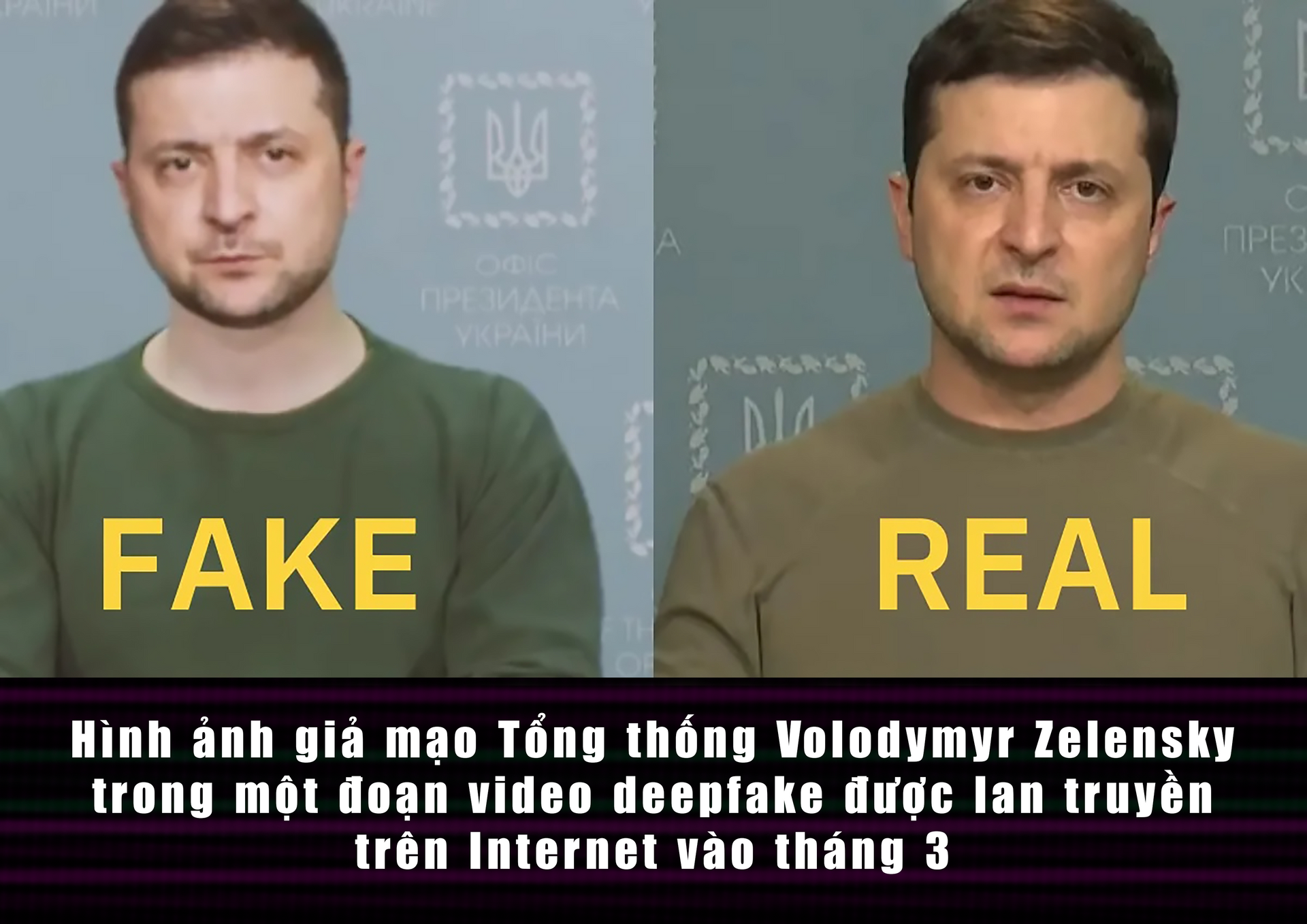

Chưa dừng lại ở đó, deepfake hiện còn bị lạm dụng để thao túng, phát tán thông tin giả mạo trong một cuộc xung đột. Giữa tháng 3, khi xung đột giữa Nga - Ukraine đang diễn ra căng thẳng, một đoạn video giả mạo về Tổng thống Ukraine Volodymyr Zelensky đã lan truyền khắp các trang mạng xã hội.

Trong video này, ông Zelensky xuất hiện với một chiếc áo màu xanh lá cây sẫm, đứng phía sau bục phát biểu của Tổng thống và nói một cách chậm rãi. Ngoại trừ phần đầu, cơ thể của vị Tổng thống gần như không cử động. Với giọng nói méo mó và khô khan một cách kỳ lạ, ông khuyên người dân Ukraine hãy đầu hàng Nga.

"Tôi yêu cầu các bạn hạ vũ khí và trở về với gia đình. Cuộc chiến này không đáng để hy sinh. Tôi mong muốn các bạn có thể tiếp tục sống và tôi cũng sẽ làm như vậy", thông tin sai lệch được đưa ra ở đoạn video.

Ngay lập tức, người nghe đã xác định rằng đây chỉ là một video giả mạo và được tạo ra bằng công nghệ deepfake. Các trang mạng xã hội như Facebook, Twitter,... cũng lập tức gỡ bỏ và chặn đoạn video này khỏi nền tảng của họ không lâu sau đó.

Bên cạnh video giả mạo về Tổng thống Zelensky, một video deepfake khác cũng được lan truyền rộng rãi, chứa hình ảnh Tổng thống Nga Vladimir Putin tuyên bố tình trạng hòa bình, kết thúc cuộc chiến với Ukraine.

Trong nhiều năm, các chuyên gia đã bày tỏ sự lo lắng về khả năng lan truyền những thông tin giả mạo, có thể gây ra tình trạng hỗn loạn của các video deepfake. Theo CNN, công nghệ deepfake đã có được nhiều bước phát triển chỉ trong một khoảng thời gian ngắn. Chẳng hạn, các video về cảnh Tom Cruise tung đồng xu và hát các bài hát của ban nhạc Dave Matthews vào năm ngoái đã cho thấy công nghệ deepfake có thể tạo ra những video "thật" đến mức nào.

Những video giả mạo gần đây về Tổng thống Zelensky hay Putin đều không đạt được mức độ lan tỏa cao như video về Tom Cruise. Nguyên nhân là do chúng có độ phân giải thấp, nhằm che giấu những sai sót dễ bị phát hiện.

Tuy vậy, các chuyên gia vẫn nhận thấy rằng chúng vô cùng nguy hiểm. Đó là bởi những thông tin sai lệch sử dụng công nghệ cao có thể phát tán rất nhanh trên quy mô toàn cầu. Khi những video deepfake phổ biến, việc chọn lọc thông tin trên mạng sẽ trở nên khó khăn hơn.

"Một khi ranh giới giữa thật và giả bị lu mờ, sự thật sẽ không còn tồn tại. Bạn sẽ không dám tin vào những điều mà chính mắt mình nhìn thấy. Chúng ta sẽ mất niềm tin vào mọi thứ", Wael Abd-Almageed, phó giáo sư nghiên cứu tại Đại học Nam California, kiêm Giám đốc sáng lập Phòng thí nghiệm phân tích đa phương tiện và trí tuệ thị giác, nhận định.

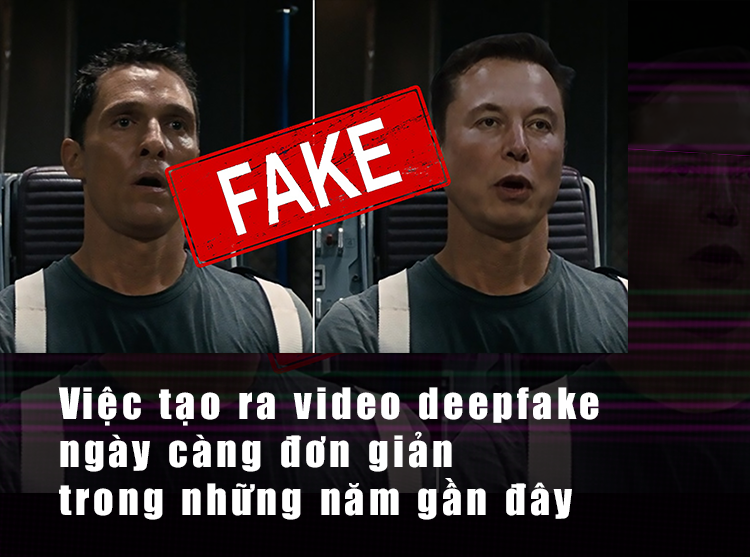

Siwei Lyu, Giám đốc phòng thí nghiệm máy học và tầm nhìn máy tính tại Đại học Albany, cho rằng trong vài năm trước, việc tạo ra một video deepfake chất lượng cao không phải là điều dễ dàng. Tuy nhiên, điều này đã trở nên đơn giản hơn nhiều trong thời điểm hiện tại.

Các chuyên gia cũng nhận định rằng việc sử dụng công nghệ này để tác động đến mọi người trong chiến tranh là vô cùng nguy hiểm. Nó có thể gây ra sự nhầm lẫn, từ đó kéo theo vô số các rủi ro.

"Trong những trường hợp thông thường, deepfake có thể không gây ra nhiều tác động, ngoài việc thu hút sự quan tâm và chú ý trên mạng xã hội. Tuy nhiên, trong những tình huống nguy cấp như chiến tranh hay thảm họa, mọi người chỉ có thể tiếp nhận thông tin trong một khoảng thời gian rất ngắn và sẽ không thể suy nghĩ một cách thấu đáo. Những video giả mạo sẽ trở thành một vấn đề lớn", Lyu cho biết.

Trong thời gian đầu phát triển, deepfake còn tồn tại khá nhiều hạn chế như hình ảnh mờ, video bị lỗi giọng nói và hiệu ứng. Tuy nhiên, thời điểm hiện tại, các nội dung deepfake đã trở nên tinh vi và hoàn thiện hơn. Việc nhận diện chúng cũng trở nên khó khăn hơn trước rất nhiều.

Hiện tại, chưa có một phương pháp cụ thể nào giúp phát hiện chính xác được video deepfake. Tuy nhiên, thông qua một số dấu hiệu, người dùng vẫn có khả năng nhận diện được nội dung giả mạo từ công nghệ này.

Các chi tiết nhỏ: Thời gian qua, công nghệ chỉnh sửa của deepfake đã có nhiều cải tiến đáng kể. Tuy vậy, nó vẫn chưa thực sự hoàn hảo, đặc biệt là ở các chi tiết như chuyển động của tóc, mắt hay biểu cảm gương mặt. Đây vẫn được xem là một lỗ hổng lớn của công nghệ này.

Cảm xúc: Một điểm dễ nhận biết khác trên video deepfake là cảm xúc thể hiện trên gương mặt nhân vật. Công nghệ này chỉ có thể mô phỏng các biểu cảm như tức giận, vui vẻ, hạnh phúc ở mức trung bình. Theo các chuyên gia, để đạt tới mức độ chân thực giống như người bình thường, deepfake sẽ cần một khoảng thời gian rất dài nữa.

Chất lượng video: Để khắc phục 2 điểm yếu trên, những video deepfake thường có chất lượng không cao. Chính vì thế, người dùng cũng có thể dựa vào yếu tố này để nhận diện các nội dung giả mạo.

Khi deepfake ngày càng trở nên tinh vi hơn, nhiều nhà nghiên cứu và các công ty cũng cố gắng cập nhật công cụ để phát hiện ra chúng. Abd-Almageed và Lyu đã sử dụng nhiều thuật toán để phát hiện ra deepfake.

Giải pháp của Lyu được đặt tên là DeepFake-o-meter, cho phép bất kỳ ai tải video lên để kiểm tra tính xác thực của nó. Tuy nhiên, công cụ này có thể mất vài giờ để tìm ra kết quả. Một số công ty khác như Zemana cũng đang phát triển phần mềm riêng của họ để phát hiện deepfake. Dĩ nhiên, nếu muốn hoạt động một cách hiệu quả, tính năng này cũng cần được cập nhật thường xuyên để theo kịp với khả năng giả mạo của deepfake.

"Chúng ta sẽ thấy những video deepfake nhiều hơn. Việc dựa vào các nền tảng như Google, Facebook, Twitter là không đủ", Lyu nói.

Nội dung: Thế Anh

Thiết kế: Nguyễn Vượng

06/05/2022